Ceph是一个开源的、高度可扩展的分布式存储系统,其设计目标是提供高性能、高可靠性和无单点故障的存储服务。以下是对Ceph数据处理和存储支持服务的关键知识点整理:

一、Ceph架构核心组件

- RADOS(可靠自主分布式对象存储):Ceph的核心底层存储系统,负责数据分布、复制和故障恢复。

- MON(Monitor):维护集群状态映射,包括OSD Map、PG Map和CRUSH Map,确保集群一致性。

- OSD(Object Storage Daemon):负责数据存储、复制和恢复,每个OSD守护进程管理一块物理磁盘。

- MDS(Metadata Server):仅用于CephFS,管理文件系统元数据。

二、数据处理流程

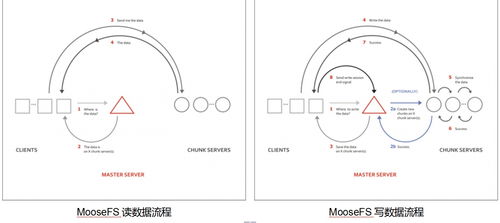

- 数据写入过程:

- 客户端通过CRUSH算法计算数据对象应存储的PG(Placement Group)。

- 根据PG映射到一组OSD,实现数据的分布式存储和冗余。

- 数据写入采用Primary-Secondary模型,确保一致性和高可用。

- 数据读取过程:

- 客户端直接与Primary OSD交互获取数据,减少延迟。

- 若Primary OSD故障,自动切换到其他OSD。

- 数据均衡与恢复:

- Ceph通过CRUSH算法动态调整数据分布,避免热点问题。

- 当OSD故障或新增时,自动触发数据迁移和恢复,保持数据冗余级别。

三、存储支持服务

- 对象存储(RADOSGW):

- 提供与AWS S3和Swift兼容的RESTful API,适用于云存储和大规模非结构化数据。

- 支持多租户和访问控制。

- 块存储(RBD):

- 提供虚拟块设备,支持快照、克隆和镜像功能,适用于虚拟机存储和数据库。

- 与KVM、OpenStack等虚拟化平台无缝集成。

- 文件系统存储(CephFS):

- 提供符合POSIX标准的分布式文件系统,支持多客户端并发访问。

- 依赖MDS管理元数据,确保文件系统的一致性和性能。

四、数据一致性与可靠性机制

- CRUSH算法:

- 基于伪随机分布的数据定位算法,避免中央元数据查询瓶颈。

- 支持自定义故障域,提高数据可靠性。

- 副本与纠删码:

- 默认采用多副本机制(通常为3副本),确保数据冗余。

- 支持纠删码(Erasure Coding),在保证可靠性的同时显著降低存储开销。

- 心跳与故障检测:

- MON和OSD通过心跳机制实时监控节点状态,快速检测故障并触发恢复。

五、性能优化与扩展性

- 数据分布策略:通过调整CRUSH规则优化数据分布,提升I/O性能。

- 缓存机制:支持分层存储,结合SSD作为缓存层加速热点数据访问。

- 横向扩展:通过增加OSD节点线性提升存储容量和吞吐量,无单点瓶颈。

六、应用场景

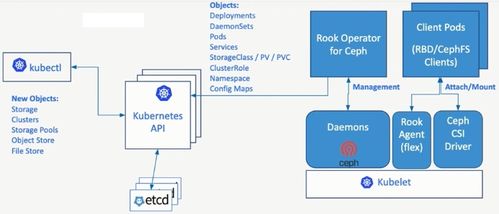

- 云计算平台:作为OpenStack、Kubernetes的后端存储,提供弹性块和对象存储。

- 大数据分析:支持Hadoop、Spark等框架,处理海量非结构化数据。

- 备份与归档:利用其高可靠性和低成本特性,用于长期数据保存。

Ceph通过其分布式架构和灵活的数据处理机制,为企业级应用提供了高性能、高可靠的存储解决方案。深入理解其核心组件、数据处理流程及存储服务,有助于优化部署和运维实践。